Meta加速自研芯片以重新定义AI权力

Meta于2026年3月11日宣布了一项四代自行研发的AI芯片路线图,名为Meta Training and Inference Accelerator,简称MTIA 300、MTIA 400、MTIA 450和MTIA 500。需要关注的重点不是这些芯片的名称,而是其推出节奏:每六个月推出一款新芯片,计划到2027年底完成全面部署。目前,MTIA 300已经在数据中心投入生产,负责排名和推荐模型的训练;MTIA 400即将推出,扩大了对更多AI负载的支持,包括生成式AI的推理;而MTIA 450和500将推动到2027年的大规模生成式推理。这一切都在2026年2月18日与Nvidia签订的多年采购协议的背景下进行,这一协议的内容是购买数百万个Nvidia芯片,涵盖现有和未来的GPU以及CPU。

乍一看,这似乎是一种自相矛盾:在宣称独立的同时,大量采购Nvidia的芯片。然而,从工业战略来看,这实际上是权力结构的重新布局。Meta试图将其最大的一项开支和风险——AI计算能力,转变为可以谈判的资产:特定负载的自有能力,以及为了弹性和覆盖而进行的外部采购。

作为战略家,我认为这是对价值链内部进行价值重新分配的尝试:谁获得边际利润,谁承担供应风险,谁承受价格波动,谁在模式变化时享有灵活性。

自研芯片不是为了与Nvidia竞争,而是为了减少支出

常见的“技术主权”叙事往往掩盖了一个核心要点:自研芯片并不是出于自豪感的选择,而是基于单位经济的考量。Meta表示,其MTIA芯片在其排名和推荐模型上比商用GPU更具效率,在计算、内存带宽和能力上根据内部需求进行平衡。这一目标并不在于获得公共基准的胜利,而是降低训练和推理的成本,尤其是在耗费计算时间的模型中。

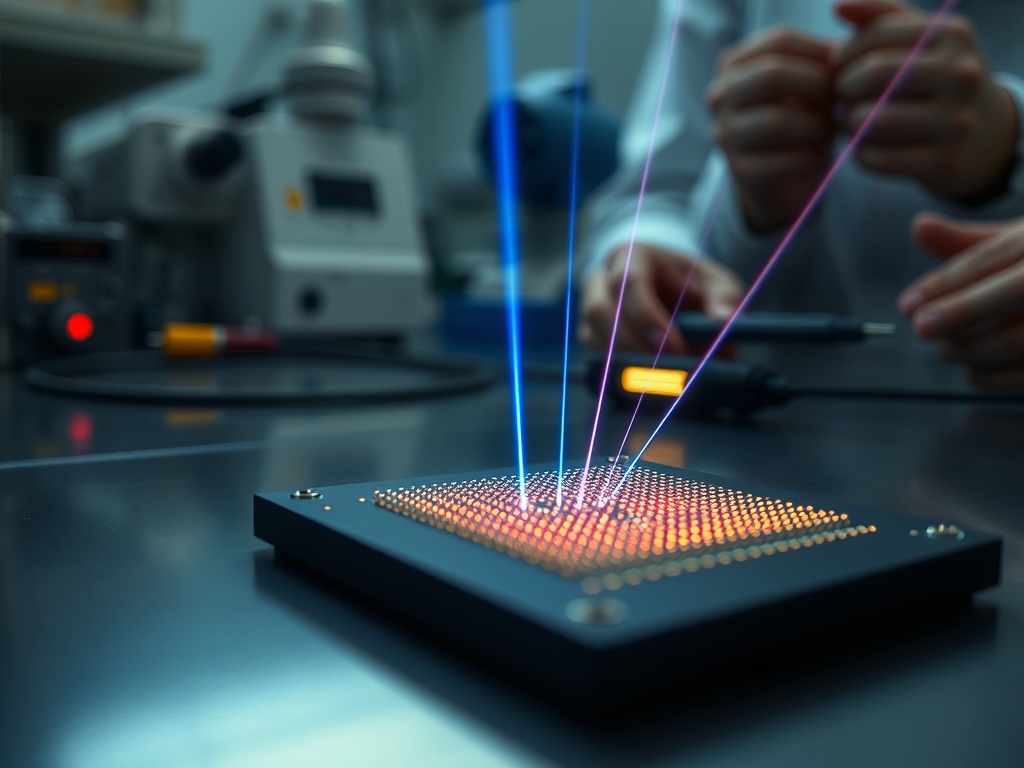

在一家依赖推荐业务的公司中,每一个效率提升都具有倍增效应。如果自研加速器能够以更少的能耗、设备和时间实现同样的效果,节省的成本就不仅是线性的:它还会减轻电力基础设施、冷却和数据中心扩展方面的压力。简报提到在一个芯片实验室进行的验证,该实验室在服务器伴随液冷之前,会对到货的芯片进行逐层测试。虽然这一验证投资成本高昂,但其目标只有一个:可预测性。可预测性使得计划计算能力、协商供应合同及避免不必要的超量采购成为可能,从而避免资本闲置。

与此同时,Meta并没有说“再见,Nvidia”。其通过对数百万个芯片的多年采购协议来确保供应。这种双重策略是理性的:自有硬件在软件和工作负载稳定和可重复时高效;GPU仍然是处理高峰、架构变更和通用负载的保险。理想的结果是账单的波动性减少,市场价格和稀缺性对其影响降低。

这里的独立性并非二元的,而是一个曲线。每一代进入生产的MTIA将会将部分开支从具有价格控制权的供应商转移到Meta内部的一个平台,后者可以控制设计和时间表。

每六个月发布新芯片和验证实验室,速度是工业优势

Meta正在加速设计和部署周期:到2027年,每六个月发布一代新芯片。在半导体行业,这一举措是一种意图声明。生成式AI市场正打击那些仍然计划架构如同模型变化周期为三年的企业。而Meta试图将硅的节奏与产品的节奏对齐。

简报提供了一个常被忽视的细节:实验室验证从生产到的芯片,通过性能、成本和能耗测试,才会进入液冷服务器。这一顺序暗示Meta正在构建一种内部能力,不仅仅是“设计ASIC”,而是在组织内部运营一个逻辑工厂:规格、验证、测试、机架整合和大规模部署。如果没有这样一条链条,自研芯片将仅仅停留在演示文稿阶段。

然而,这样的六个月节奏也带来了紧张关系。加速意味着在生产中必须以更少的学习时间做出决策。根据历史背景,Meta已经在内部目标上经历了延迟,并通过收购来增强人才。这是与主要风险一致的:设计一个芯片并不难,关键是实现稳定的重复性,而且不能影响与软件堆栈的兼容性和可靠性。

从分配的角度来看,速度还有第二个影响:重新配置与供应商的谈判。一个可以用自有能力替代部分需求的买家获得更多谈判空间。他们不需要与Nvidia或AMD决裂;而是需要以一个可靠的替代方案站在谈判桌上。在市场份额占据主导地位和存在瓶颈的情况下,可靠的替代方案就是避免支付“紧急价格”的关键。

与此同时,整个行业都在这样发展:谷歌推出TPU,AWS推出Trainium和Inferentia,微软推出Azure Maia。Meta并没有创新这一模式,而是将其加速到自身的日程中。

MTIA的赌注重塑了价值链中的赢家和输家

当一家公司在AI加速器上进行垂直整合时,价值的重新分配并非抽象。四个方面会发生变化:计算价格、能源成本、供应风险和技术依赖。

对Meta而言,最直接的上行空间在于捕捉到部分原本留给GPU供应商的利润,特别是在Meta有高度重复的负载中:排名、推荐以及逐步发展中的生成式AI推理。如果MTIA 300已经开始处理信息流的训练,Meta很聪明地从自身有高需求及明确需求的领域开始。接下来,MTIA 400则向生成式推理扩展,而MTIA 450/500将在2027年推动生成式推理的大规模应用。这一进展是合理的:首先处理每日开支,其次关注未来的产品修正。

对于Nvidia等供应商而言,其影响则是混合的。一方面,Meta与Nvidia签署了采购数百万个芯片的协议,确保了需求。另一方面,Meta实际降低了“被俘”的采购份额。从长远来看,这将刺激那些该自研芯片能够竞争的领域的价格。而Nvidia在那些对通用性和软件依赖更重的领域仍保持优势,但在专业化负载方面失去了捕获全部利润的能力。

对于数据中心生态系统而言,隐藏的成本是:运营自有硬件需要人才和流程,这会与内部资源竞争。支出不止是资本支出(CAPEX),也是组织焦点。Meta已经预见到2026年高额的资本支出,预计将在数据中心的投资超过400亿美元。当资本支出增加时,规格错误变得更加昂贵,验证纪律成为战略功能。

对用户和广告商而言,影响是间接的。如果Meta降低推理成本,则可以更复杂或频繁的模型,而不是将所有压力转移到总支出上。这将维持产品性能。效率不仅是节省:还意味着以更低的成本进行更多实验的能力。

最严重的风险是,独立性的叙事导致过度整合。自主设计只有在改善负载时是资产;而当迫使软件适应硬件而不是反之时,它则成为负担。这一消息没有提供公开基准或节省数字,因此最终评估将取决于生产数据,以及六个月的节奏是否能够保持质量。

基础设施独立性需要纪律,而非宣传

Meta正在利用MTIA实现一个具体目标:确保能力并降低市场上对加速器需求仍然高涨、数据中心投资加速到2027年。简报提到到2027年IA数据中心年度支出估计将超过2000亿美元,同时提醒大家2025年的H100单元价格超过40000美元。在不需要推算自身的数字时,这一激励显然:当一种投入的成本变得战略性和波动时,公司寻求两样东西:多样化和控制。

有趣的是,Meta并没有试图替代大型供应商;而是试图重新定位关系。通过采购数百万个外部芯片确保规模和连续性,同时加速内部能力,以避免在可以专业化的负载上支付“稀缺税”。这种组合形成了一种经济韧性的设计:减少依赖性而不把运营押注于单一路径。

在这类计划中常见的盲点是混淆“自研芯片”和“可持续优势”。优势体现在硬件改善提供模型的总成本上,时间表跟随产品演变,以及组织能够无缝执行整合。验证实验室和已经活跃部署的MTIA 300是执行而非意图的信号。

新出现的价值分配格局清晰:Meta通过将专业计算转化为自有能力捕获更多盈余;供应商在这些领域失去部分定价权,尽管通过通用市场获得补偿;如果效率保持,能源和数据中心的账单将变得更加可控。在这类决策中,谁能让所有参与者愿意留在场上,谁就能获胜:如果Meta能向供应商提供充足的量和可预测性以降低依赖性,那么获胜的就是Meta,而供应商则继续成为无法被自研硅替代的弹性桥梁。