Meta acelera sus chips para renegociar el poder en la IA

Meta anunció el 11 de marzo de 2026 una hoja de ruta de cuatro generaciones de chips propios de IA, llamados Meta Training and Inference Accelerator: MTIA 300, MTIA 400, MTIA 450 y MTIA 500. El dato operativo que importa no es el nombre, sino el ritmo: aproximadamente un chip nuevo cada seis meses, con despliegue completo hacia finales de 2027. El MTIA 300 ya está en producción en centros de datos y corre entrenamiento para ranking y recomendación en los feeds; el MTIA 400 se acerca al despliegue y amplía el alcance hacia más cargas de IA, incluyendo inferencia para IA generativa; MTIA 450 y 500 empujan esa inferencia generativa a escala hacia 2027. Todo esto ocurre en paralelo a un acuerdo multianual firmado el 18 de febrero de 2026 para comprar millones de chips de Nvidia entre GPUs actuales y futuras, además de CPUs.

Leído superficialmente, parece una contradicción: comprar masivo a Nvidia mientras se anuncia independencia. Leído como estrategia industrial, es una arquitectura de poder. Meta está intentando convertir una de sus mayores fuentes de gasto y riesgo, la capacidad de cómputo para IA, en un activo negociable: capacidad propia para cargas específicas, compras externas para elasticidad y cobertura.

Como estratega, lo interpreto como un movimiento para redistribuir valor dentro de la cadena: quién captura margen, quién asume riesgo de suministro, quién paga la volatilidad de precios y quién se queda con la opcionalidad cuando cambian los modelos.

Un chip propio no compite con Nvidia, compite con tu factura

La narrativa habitual de “soberanía tecnológica” suele esconder lo esencial: el chip propio no se justifica por orgullo, se justifica por economía unitaria. La noticia deja pistas concretas. Meta afirma que sus MTIA logran mayor eficiencia que GPUs comerciales para sus modelos de ranking y recomendación, equilibrando cómputo, ancho de banda de memoria y capacidad según necesidades internas. Traducido a una cuenta de resultados, el objetivo no es ganar un benchmark público, sino bajar costo por entrenamiento y por inferencia en los modelos que más horas de cómputo consumen.

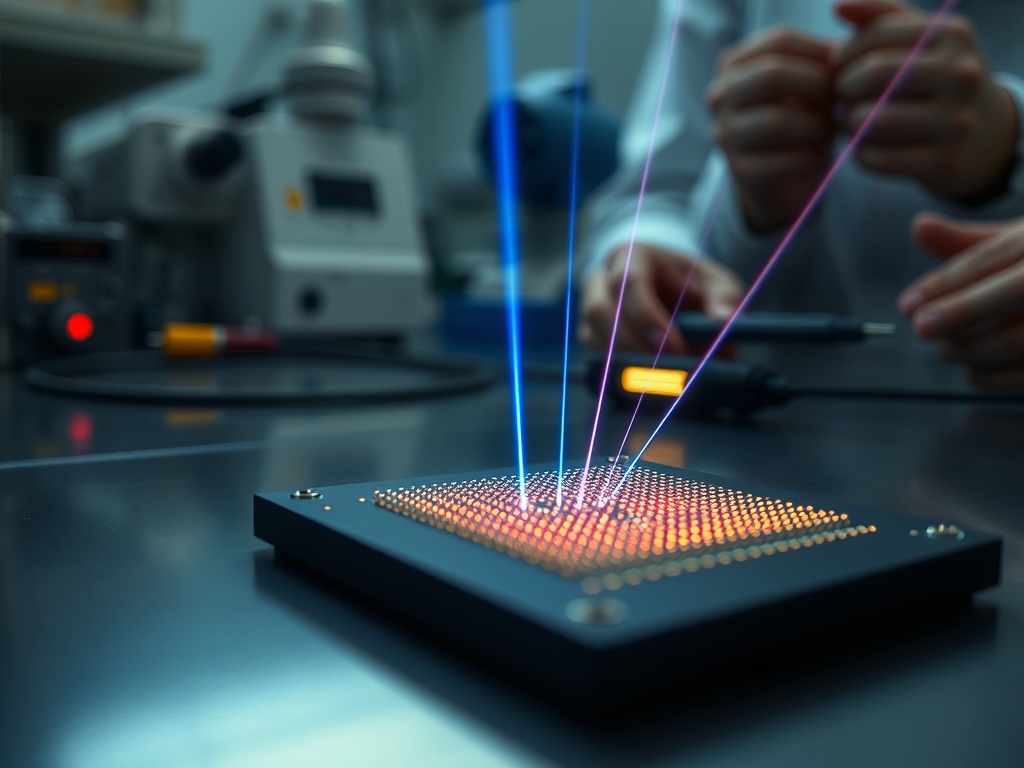

En una empresa cuyo negocio depende de recomendaciones, cada punto de eficiencia tiene un efecto multiplicador. Si un acelerador propio logra hacer lo mismo con menos energía, menos equipos, menos racks o menos tiempo, el ahorro no es lineal: también reduce presión sobre infraestructura eléctrica, refrigeración y expansión de centros de datos. El briefing menciona validación en un laboratorio de chips donde se prueba a nivel chip-rack y carga de trabajo antes del despliegue en servidores con refrigeración líquida. Esa inversión en validación es cara, pero busca una cosa: predecibilidad. La predecibilidad es lo que permite planificar capacidad, negociar contratos de suministro y evitar sobrecompras preventivas que inmovilizan capital.

Al mismo tiempo, Meta no está diciendo “adiós, Nvidia”. Está asegurando suministro con un acuerdo multianual para millones de chips. Esa dualidad es racional: el hardware propio es eficiente cuando el software y la carga de trabajo son estables y repetibles; las GPUs siguen siendo el seguro para picos, para cambios de arquitectura y para cargas generalistas. El resultado deseado es una factura menos expuesta a los precios del mercado y a la escasez.

La independencia aquí no es binaria. Es una curva. Cada generación MTIA que entra en producción mueve una porción del gasto desde un proveedor con poder de precio hacia una plataforma interna donde Meta controla el diseño y el calendario.

Cadencia semestral y laboratorio de validación, la ventaja es la velocidad industrial

Meta está acelerando el ciclo de diseño y despliegue: una generación nueva cada seis meses hasta 2027. En semiconductores, eso es una declaración de intención. El mercado de IA generativa está castigando a las empresas que planifican infraestructura como si los modelos cambiaran cada tres años. Aquí, Meta intenta alinear el ritmo del silicio con el ritmo del producto.

El briefing aporta un detalle que suele pasarse por alto: el laboratorio valida chips que llegan de fabricación, con pruebas de rendimiento, costo y consumo, antes de pasar a servidores con refrigeración líquida. Esa secuencia sugiere que Meta está construyendo una capacidad interna que no es “diseñar un ASIC”, sino operar una fábrica lógica dentro de la organización: especificación, verificación, pruebas, integración en rack y despliegue a escala. Sin esa cadena, el chip propio es un powerpoint.

La cadencia semestral, sin embargo, tiene una tensión. Acelerar significa tomar decisiones con menos tiempo de aprendizaje en producción. Meta ya tuvo, según el contexto histórico, retrasos respecto a objetivos internos y respondió con adquisiciones para sumar talento. Eso es coherente con el riesgo principal: no es diseñar un chip, es hacerlo repetible sin comprometer fiabilidad ni compatibilidad con el stack de software.

Desde la óptica distributiva, la velocidad tiene un segundo efecto: reconfigura la negociación con proveedores. Un comprador que puede reemplazar parte de su demanda por capacidad propia gana margen de maniobra. No necesita abandonar a Nvidia o AMD; necesita llegar a la mesa con una alternativa creíble. En mercados con cuotas dominantes y cuellos de botella, la alternativa creíble es lo que evita pagar “precio de urgencia”.

En paralelo, la industria entera se está moviendo así: Google con TPUs, AWS con Trainium e Inferentia, Microsoft con Azure Maia. Meta no innova el patrón; lo acelera en su propio calendario.

La apuesta por MTIA reordena ganadores y perdedores en la cadena de valor

Cuando una empresa integra verticalmente aceleradores de IA, la redistribución de valor no es abstracta. Cambian cuatro cuentas: precio del cómputo, costo energético, riesgo de suministro y dependencia tecnológica.

Para Meta, el upside más directo es capturar parte del margen que antes quedaba en proveedores de GPUs para las cargas donde Meta tiene alta repetición: ranking, recomendación y, progresivamente, inferencia de IA generativa. Si el MTIA 300 ya corre entrenamiento de feeds, Meta está empezando por donde tiene volumen y claridad de requisitos. Luego extiende con MTIA 400 hacia inferencia generativa, y con MTIA 450/500 hacia escala de inferencia generativa en 2027. Esa progresión es sensata: primero lo que paga la factura todos los días, después lo que define el futuro del producto.

Para proveedores como Nvidia, el efecto es mixto. Por un lado, Meta firma un acuerdo para comprar millones de chips y asegura demanda. Por otro, Meta reduce la porción “cautiva” de su compra. A largo plazo, eso disciplina precios en los segmentos donde el chip propio compite. Nvidia mantiene su ventaja donde la generalidad y el software pesan más, pero pierde capacidad de capturar todo el excedente en cargas especializadas.

Para el ecosistema de centros de datos, aparece un costo oculto: operar hardware propio exige talento y procesos que compiten por recursos internos. La cuenta no es solo CAPEX, también es foco organizacional. Meta ya anticipa un CAPEX 2026 alto, con previsiones por encima de 40.000 millones de dólares en gran parte orientados a centros de datos. Cuando el CAPEX sube, los errores de especificación se vuelven caros y la disciplina de validación se vuelve una función estratégica.

Para usuarios y anunciantes, el impacto se materializa indirectamente. Si Meta reduce costo por inferencia, puede servir modelos más complejos o más frecuentes sin trasladar toda la presión al gasto total. Eso sostiene el rendimiento del producto. La eficiencia no es solo ahorro: también es capacidad de experimentar más barato.

El riesgo más serio es que la narrativa de independencia empuje a una integración excesiva. Un diseño propio es un activo cuando mejora una carga; es un lastre cuando obliga a adaptar el software al hardware en vez de al revés. La noticia no trae benchmarks públicos ni cifras de ahorro, así que la evaluación final dependerá de datos de producción y de si el ritmo semestral sostiene calidad.

La independencia de infraestructura se compra con disciplina, no con anuncios

Meta está usando MTIA para un objetivo concreto: asegurar capacidad y bajar costos en un mercado donde la demanda de aceleradores no afloja y la inversión en centros de datos se acelera hacia 2027. El briefing menciona estimaciones de gasto anual en centros de datos de IA por encima de 200.000 millones de dólares para 2027, y también recuerda que en 2025 unidades H100 superaron los 40.000 dólares. Sin necesidad de extrapolar números propios, el incentivo es obvio: cuando el costo de un insumo se vuelve estratégico y volátil, la empresa busca dos cosas, diversificación y control.

Lo interesante es que Meta no intenta reemplazar a los grandes proveedores; intenta reposicionar la relación. Compra millones de chips externos para asegurar escala y continuidad, y al mismo tiempo acelera su capacidad interna para no pagar el “impuesto de escasez” en las cargas donde puede especializarse. Esa combinación es un diseño de resiliencia financiera: reduce dependencia sin apostar la operación a una sola vía.

El punto ciego típico en estos programas es confundir “chip propio” con “ventaja sostenible”. La ventaja aparece si el hardware mejora el costo total de servir modelos, si el calendario acompaña la evolución del producto y si la organización ejecuta la integración sin fricción. El laboratorio de validación y el despliegue ya activo del MTIA 300 son señales de ejecución, no de intención.

La distribución de valor que emerge es clara: Meta captura más excedente al convertir cómputo especializado en capacidad propia; los proveedores pierden parte del poder de precio en esas cargas, aunque compensan con volumen generalista; la factura energética y de centros de datos se vuelve más gobernable si la eficiencia se sostiene. En decisiones así, gana quien logra que todos los actores prefieran permanecer: Meta si entrega volumen y previsibilidad a sus proveedores mientras reduce dependencia, y los proveedores si siguen siendo el puente de elasticidad que el silicio propio no puede reemplazar.