Agentes de IA para empresas: quién diseña las reglas del juego

El 24 de febrero de 2026, Anthropic anunció su programa de agentes empresariales: un conjunto de módulos preconstruidos para desplegar su modelo Claude en tareas de finanzas, recursos humanos, legal e ingeniería, conectados con herramientas como Gmail, DocuSign y plataformas de datos. El anuncio fue preciso y técnicamente sólido. La promesa, que en palabras de su directora para América Kate Jensen corrige el fracaso de enfoque —no de esfuerzo— que caracterizó a 2025, es que esta vez la IA llegará de verdad a operar dentro de los flujos reales de trabajo corporativo.

Con 100 millones de descargas mensuales de su protocolo de conexión estandarizado y Claude Code escalando hasta convertirse en un producto de facturación billonaria en seis meses, Anthropic no está especulando. Está ejecutando. Y cuando una empresa de ese peso mueve fichas de esta magnitud, los líderes empresariales tienen dos opciones: leer el comunicado de prensa o leer la arquitectura que está debajo.

Yo hago lo segundo.

La promesa es modular, el riesgo también

El modelo de Anthropic es inteligente desde la ingeniería de producto. En lugar de vender una plataforma monolítica que cada empresa deba adaptar desde cero, ofrece módulos funcionales —un agente para modelado financiero, otro para generar descripciones de puestos, otro para especificaciones técnicas— que los equipos de IT pueden personalizar dentro de mercados internos controlados. Matt Piccolella, su responsable de producto, lo sintetizó así: cada persona debería tener su propio agente a medida, gestionado desde el centro.

Esta arquitectura modular convierte costos que antes eran fijos —consultores, licencias de software especializado, desarrollos a medida— en despliegues variables que escalan según el uso. Para una pequeña o mediana empresa con recursos limitados de IT, eso representa un cambio de lógica financiera significativo. Deja de pagar por capacidad instalada y paga por resultado operativo.

Pero la modularidad tiene un espejo oscuro: cada módulo hereda los supuestos de quien lo diseñó. Un agente de RRHH que genera ofertas de empleo, materiales de incorporación y cartas de oferta no es neutral. Refleja una idea implícita de qué candidato es deseable, qué lenguaje es profesional, qué estructura de carrera es la norma. Esos supuestos no se alojan en el código de forma visible. Se alojan en los datos con los que el modelo fue entrenado y, antes aún, en las decisiones de quiénes eligieron esos datos.

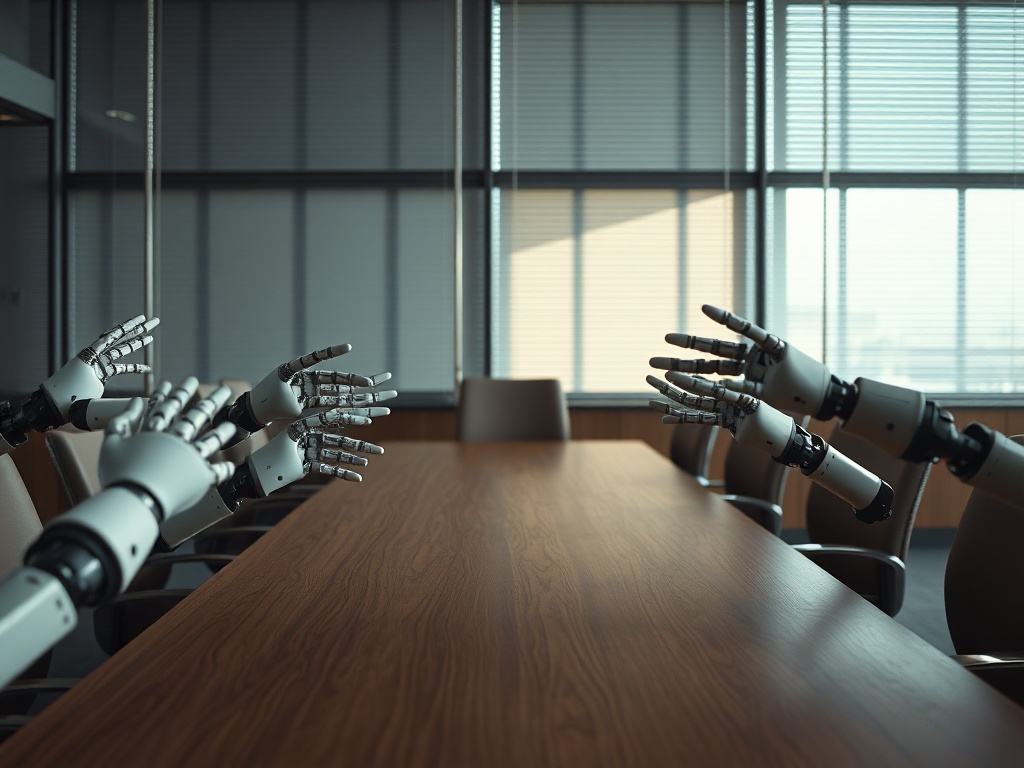

La pregunta que ningún comunicado de lanzamiento responde es: quiénes estaban en esa sala.

Cuando el punto ciego se automatiza a escala

Hay un dato en el briefing de Anthropic que merece atención directa: el análisis de millones de interacciones humano-agente muestra que casi el 50% de la actividad agentica se concentra en ingeniería de software. Finanzas, salud y ciberseguridad aparecen como sectores emergentes. Eso significa que los patrones de uso que informaron el diseño del sistema —los comportamientos que el modelo aprendió como "normales" y eficientes— provienen de un perfil de usuario muy específico.

Los equipos de ingeniería de software son, en términos de composición demográfica, uno de los segmentos laborales más homogéneos de la economía global. Cuando ese perfil genera el 50% de la señal de entrenamiento para un sistema que luego se desplegará en recursos humanos, finanzas y legal —funciones que gestionan contratación, compensación, crédito, cumplimiento— la homogeneidad del origen contamina la amplitud del destino.

Esto no es una acusación a Anthropic. Es un diagnóstico estructural que aplica a toda la industria y que los líderes corporativos que adopten estas herramientas deben incorporar a su evaluación de riesgo. Un agente de IA que automatiza la criba de currículums en un departamento de RRHH puede reducir el tiempo del proceso en un porcentaje sustancial. También puede replicar a una velocidad industrial los sesgos que antes tardaban semanas en operar. La ganancia de eficiencia y el riesgo de sesgo no son fuerzas que se cancelan: se multiplican juntas.

Las empresas medianas, que no tienen equipos de auditoría de algoritmos ni oficinas de ética tecnológica, son particularmente vulnerables a este patrón. Adoptan la herramienta por los beneficios de velocidad —legítimos— y asumen que si viene de un proveedor reconocido, el problema del sesgo ya fue resuelto. No fue resuelto. Fue tercerizado.

La red que sostiene la herramienta importa tanto como la herramienta

Hay otro ángulo en este lanzamiento que los análisis técnicos tienden a ignorar. Anthropic anunció simultáneamente la expansión de su división experimental con el cofundador de Instagram al frente y la incorporación de una nueva responsable de producto proveniente del sector. Se trata de una red de vínculos estratégicos construida sobre reputaciones cruzadas, historiales compartidos y confianza acumulada en círculos muy específicos del ecosistema tecnológico de Silicon Valley.

Esa red tiene valor. También tiene límites geográficos, culturales y sectoriales muy concretos. Una red de capital social construida dentro de un mismo perímetro no detecta las señales que vienen de fuera de ese perímetro. Para las empresas que operan en mercados latinoamericanos, del sur de Europa o del sudeste asiático, eso implica que las prioridades de diseño del producto raramente reflejarán sus fricciones operativas específicas: marcos legales distintos, estructuras laborales diferentes, culturas de gestión que no encajan con los supuestos anglosajones que subyacen a los módulos preconstruidos.

La promesa de personalización vía mercados internos privados es real, pero tiene un piso de partida. Y ese piso fue construido desde un lugar determinado, por personas determinadas, con experiencias determinadas. Las empresas que entiendan esto podrán extraer valor del sistema; las que no lo entiendan adoptarán acríticamente un conjunto de supuestos que no les pertenecen.

La decisión de integrar agentes de IA en procesos de RRHH, finanzas o legal no es solo una decisión tecnológica. Es una decisión de gobernanza. Implica elegir qué criterios automatizar, qué flujos acelerar y, por omisión, qué perspectivas quedan fuera del proceso de decisión. Esas elecciones tienen consecuencias operativas medibles: en calidad de contratación, en exposición legal, en capacidad de atender mercados diversos. Las organizaciones que traten la adopción de agentes de IA como una decisión de IT en lugar de una decisión de directorio están midiendo mal el riesgo.

El directorio que no vio venir su propio punto ciego

El lanzamiento de Anthropic no es el problema. Es el espejo. Muestra con claridad que la próxima capa de infraestructura corporativa —los agentes que gestionarán contrataciones, evaluarán crédito, redactarán contratos— está siendo diseñada por equipos con perfiles muy similares entre sí, para clientes que también tienden a parecerse entre sí, con datos que reflejan comportamientos de usuarios que en un 50% provienen de un solo sector.

Los líderes que adopten estas herramientas sin auditar los supuestos que vienen integrados en ellas no estarán ahorrando tiempo. Estarán delegando sus decisiones más sensibles a un sistema que no fue calibrado para su realidad específica. Y cuando ese sistema falle —porque fallará, en algún proceso, ante algún perfil de candidato o cliente que no encajó en el molde— la responsabilidad no será del proveedor. Será de quien firmó la adopción sin hacer las preguntas que correspondían.

La próxima vez que el directorio se reúna para aprobar la integración de agentes de IA, vale la pena que cada persona en esa sala mire a su alrededor. Si todos llegaron por los mismos caminos, trabajaron en los mismos sectores y comparten los mismos marcos de referencia, ya tienen la respuesta sobre qué puntos ciegos ese directorio tiene garantizados. Y esos puntos ciegos son exactamente lo que el sistema que están a punto de adoptar va a amplificar.