Meta Acelera Seus Chips para Renegociar o Poder na IA

Meta anunciou no dia 11 de março de 2026 uma folha de rota de quatro gerações de chips próprios de IA, chamados Meta Training and Inference Accelerator: MTIA 300, MTIA 400, MTIA 450 e MTIA 500. O dado operacional que realmente importa não é o nome, mas sim o ritmo: aproximadamente um chip novo a cada seis meses, com o lançamento completo previsto para final de 2027. O MTIA 300 já está em produção em centros de dados e realiza treinamento para ranking e recomendação em feeds; o MTIA 400 está próximo do lançamento e amplia o alcance para mais cargas de IA, incluindo inferência para IA generativa; os MTIA 450 e 500 empurram essa inferência gerativa em grande escala até 2027. Tudo isso ocorre em paralelo a um acordo multianual assinado em 18 de fevereiro de 2026 para a compra de milhões de chips da Nvidia, incluindo GPUs atuais e futuras, além de CPUs.

A primeira vista, isso pode parecer uma contradição: comprar em massa da Nvidia enquanto se anuncia independência. Porém, visto como estratégia industrial, trata-se de uma arquitetura de poder. A Meta está tentando converter uma das suas maiores fontes de gasto e risco, a capacidade computacional para IA, em um ativo negociável: capacidade própria para cargas específicas, compras externas para elasticidade e cobertura.

Como estrategista, interpreto isso como um movimento para redistribuir valor dentro da cadeia: quem captura margem, quem assume o risco de fornecimento, quem arca com a volatilidade de preços e quem fica com a opcionalidade quando os modelos mudam.

Um Chip Próprio Não Compete com a Nvidia, Compete com Sua Conta

A narrativa habitual de "soberania tecnológica" frequentemente esconde o essencial: o chip próprio não se justifica por orgulho, mas sim pela economia unitária. As notícias deixam pistas concretas. A Meta afirma que seus MTIA alcançam maior eficiência do que GPUs comerciais para seus modelos de ranking e recomendação, equilibrando computação, largura de banda de memória e capacidade de acordo com as necessidades internas. Traduzido para uma conta de resultados, o objetivo não é ganhar um benchmark público, mas reduzir o custo por treinamento e por inferência nos modelos que mais tempo de computação consomem.

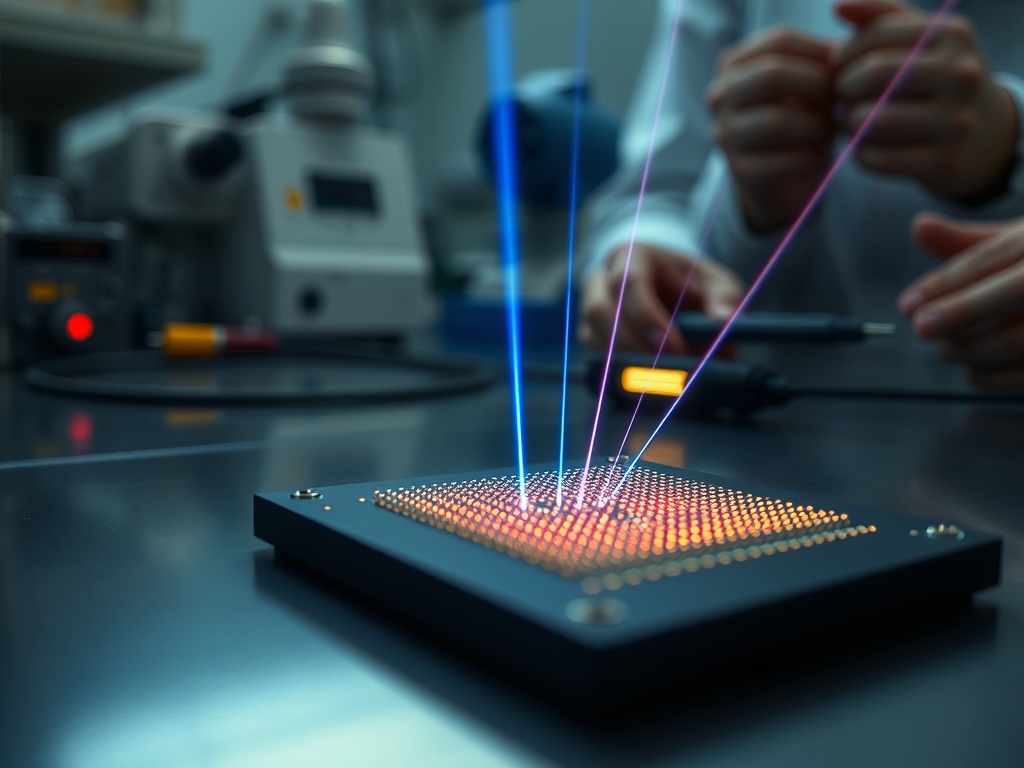

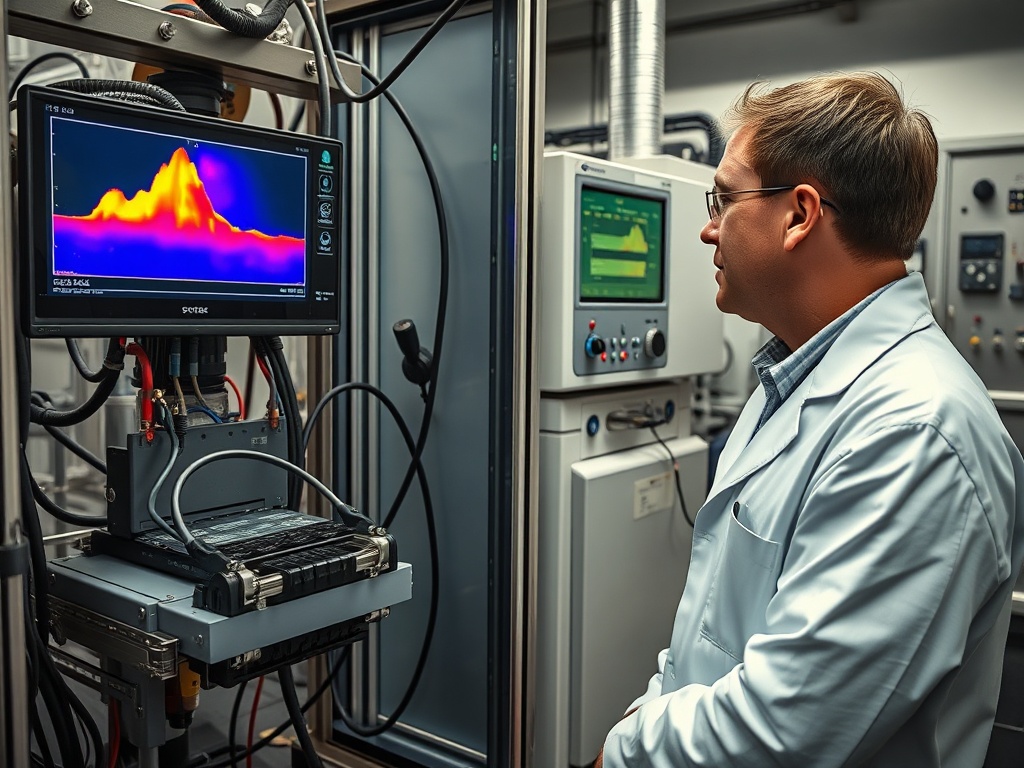

Em uma empresa cujo negócio depende de recomendações, cada ponto de eficiência tem um efeito multiplicador. Se um acelerador próprio consegue fazer o mesmo com menos energia, menos equipamentos, menos racks ou menos tempo, a economia não é linear: também reduz a pressão sobre a infraestrutura elétrica, refrigeração e expansão de centros de dados. O briefing menciona validação em um laboratório de chips onde eles são testados em nível chip-rack e carga de trabalho antes do lançamento em servidores com refrigeração líquida. Esse investimento em validação é caro, mas busca uma coisa: previsibilidade. A previsibilidade é o que permite planejar capacidade, negociar contratos de fornecimento e evitar sobrecompras que imobilizam capital.

Ao mesmo tempo, a Meta não está dizendo "adeus, Nvidia". Está garantindo fornecimento com um acordo multianual para milhões de chips. Essa dualidade é racional: o hardware próprio é eficiente quando o software e a carga de trabalho são estáveis e repetíveis; as GPUs continuam sendo o seguro para picos, alterações de arquitetura e cargas generalistas. O resultado desejado é uma fatura menos exposta aos preços do mercado e à escassez.

A independência não é aqui binária. É uma curva. Cada geração MTIA que entra em produção move uma porção do gasto de um fornecedor com poder de preço para uma plataforma interna onde a Meta controla o design e o cronograma.

Cadência Semestral e Laboratório de Validação: A Velocidade É a Vantagem Industrial

Meta está acelerando o ciclo de design e lançamento: uma nova geração a cada seis meses até 2027. No setor de semicondutores, isso é uma declaração de intenção. O mercado de IA generativa está penalizando as empresas que planejam infraestrutura como se os modelos mudassem a cada três anos. Aqui, a Meta tenta alinhar o ritmo do silício com o ritmo do produto.

O briefing fornece um detalhe que costuma ser negligenciado: o laboratório valida chips que chegam da fabricação, com testes de desempenho, custo e consumo, antes de serem entregues a servidores com refrigeração líquida. Essa sequência sugere que a Meta está construindo uma capacidade interna que não é apenas "projetar um ASIC", mas sim operar uma fábrica lógica dentro da organização: especificação, verificação, testes, integração em rack e implantação em escala. Sem essa cadeia, o chip próprio é apenas uma apresentação.

No entanto, a cadência semestral traz uma tensão. Acelerar significa tomar decisões com menos tempo de aprendizado em produção. A Meta já enfrentou, em contextos históricos, atrasos em relação aos objetivos internos e respondeu com aquisições para adicionar talento. Isso é coerente com o principal risco: não é projetar um chip, é torná-lo repetível sem comprometer a confiabilidade nem a compatibilidade com o stack de software.

Sob a ótica distributiva, a velocidade tem um segundo efeito: reconfigura a negociação com fornecedores. Um comprador que pode substituir parte de sua demanda por capacidade própria ganha margem de manobra. Não precisa abandonar a Nvidia ou a AMD; precisa chegar à mesa com uma alternativa crível. Em mercados com quotas dominantes e gargalos, uma alternativa crível é o que evita pagar "preço de urgência".

Paralelamente, a indústria inteira está se movendo dessa forma: Google com TPUs, AWS com Trainium e Inferentia, Microsoft com Azure Maia. A Meta não inova o padrão; acelera-o em seu próprio cronograma.

A Aposta por MTIA Reordena Vencedores e Perdedores na Cadeia de Valor

Quando uma empresa integra verticalmente aceleradores de IA, a redistribuição de valor não é abstrata. Quatro contas mudam: preço do computação, custo energético, risco de fornecimento e dependência tecnológica.

Para a Meta, o lado positivo mais direto é capturar parte do lucro que antes ficava em fornecedores de GPUs para as cargas onde a Meta possui alta repetição: ranking, recomendação e, progressivamente, inferência de IA generativa. Se o MTIA 300 já executa treinamento de feeds, a Meta está começando pelo que tem volume e clareza de requisitos. Depois, amplia com o MTIA 400 para inferência generativa, e com os MTIA 450/500 para escala de inferência generativa em 2027. Essa progressão é sensata: primeiro o que paga a fatura todos os dias, depois o que define o futuro do produto.

Para fornecedores como a Nvidia, o efeito é misto. Por um lado, a Meta assina um acordo para comprar milhões de chips e garante demanda. Por outro lado, a Meta diminui a porção "cautiva" de sua compra. A longo prazo, isso disciplina preços nos segmentos onde o chip próprio compete. A Nvidia mantém sua vantagem onde a generalidade e o software pesam mais, mas perde a capacidade de capturar todos os excedentes em cargas especializadas.

Para o ecossistema de centros de dados, surge um custo oculto: operar hardware próprio exige talento e processos que competem por recursos internos. A conta não é apenas CAPEX, mas também foco organizacional. A Meta já antecipa um CAPEX alto em 2026, com previsões de mais de 40 bilhões de dólares, em grande parte voltados para centros de dados. Quando o CAPEX aumenta, os erros de especificação se tornam caros e a disciplina de validação transforma-se em uma função estratégica.

Para usuários e anunciantes, o impacto se materializa indiretamente. Se a Meta reduz o custo por inferência, poderá oferecer modelos mais complexos ou mais frequentes sem transferir toda a pressão para o gasto total. Isso sustenta o desempenho do produto. A eficiência não é apenas economia: também é capacidade de experimentar mais barato.

O risco mais sério é que a narrativa de independência force uma integração excessiva. Um design próprio é um ativo quando melhora uma carga; é um fardo quando obriga a adaptar o software ao hardware em vez de ao contrário. A notícia não traz benchmarks públicos nem cifras de economia, portanto, a avaliação final dependerá de dados de produção e de se o ritmo semestral sustenta a qualidade.

A Independência de Infraestrutura se Compra com Disciplina, Não com Anúncios

A Meta está utilizando o MTIA para um objetivo concreto: assegurar capacidade e reduzir custos em um mercado onde a demanda por aceleradores não cede e o investimento em centros de dados se acelera até 2027. O briefing menciona estimativas de gastos anuais em centros de dados de IA superiores a 200 bilhões de dólares até 2027, e também recorda que, em 2025, unidades H100 superaram os 40 mil dólares. Sem necessidade de extrapolar números próprios, o incentivo é evidente: quando o custo de um insumo se torna estratégico e volátil, a empresa busca duas coisas: diversificação e controle.

O interessante é que a Meta não está tentando substituir os grandes fornecedores; está tentando reposicionar a relação. Compra milhões de chips externos para garantir escala e continuidade, e ao mesmo tempo acelera sua capacidade interna para não pagar o "imposto de escassez" nas cargas em que pode se especializar. Essa combinação é um design de resiliência financeira: reduz a dependência sem apostar a operação em um único caminho.

O ponto cego típico nesses programas é confundir "chip próprio" com "vantagem sustentável". A vantagem aparece se o hardware melhora o custo total de servir modelos, se o cronograma acompanha a evolução do produto e se a organização executa a integração sem fricções. O laboratório de validação e a implantação já ativa do MTIA 300 são sinais de execução, não de intenção.

A distribuição de valor que emerge é clara: a Meta captura mais excedente ao transformar computação especializada em capacidade própria; os fornecedores perdem parte do poder de preço nessas cargas, embora compensem com volume generalista; a fatura de energia e dos centros de dados torna-se mais controlável se a eficiência se mantém. Em decisões desse tipo, ganha quem consegue que todos os atores queiram permanecer: Meta, se entrega volume e previsibilidade a seus fornecedores enquanto reduz a dependência, e os fornecedores, se continuam sendo a ponte de elasticidade que o silício próprio não consegue substituir.