Agentes de IA para empresas: quem desenha as regras do jogo

Em 24 de fevereiro de 2026, a Anthropic anunciou seu programa de agentes empresariais: um conjunto de módulos pré-construídos para implantar seu modelo Claude em tarefas de finanças, recursos humanos, legal e engenharia, conectados a ferramentas como Gmail, DocuSign e plataformas de dados. O anúncio foi preciso e tecnicamente sólido. A promessa, nas palavras de sua diretora para a América, Kate Jensen, corrige o fracasso de enfoque — não de esforço — que caracterizou 2025, é que desta vez a IA realmente operará dentro dos fluxos reais de trabalho corporativo.

Com 100 milhões de downloads mensais de seu protocolo de conexão padronizado e Claude Code se tornando um produto bilionário em seis meses, a Anthropic não está especulando. Está executando. E quando uma empresa desse peso movimenta peças de tal magnitude, os líderes empresariais têm duas opções: ler o comunicado de imprensa ou entender a arquitetura que está por trás disso.

Eu faço a segunda opção.

A promessa é modular, o risco também

O modelo da Anthropic é inteligente do ponto de vista de engenharia de produto. Em vez de vender uma plataforma monolítica que cada empresa deva adaptar desde o zero, oferece módulos funcionais — um agente para modelagem financeira, outro para gerar descrições de cargos, um para especificações técnicas — que as equipes de TI podem personalizar dentro de mercados internos controlados. Matt Piccolella, o responsável pelo produto, resumiu assim: cada pessoa deve ter seu próprio agente sob medida, gerenciado do centro.

Essa arquitetura modular transforma custos que antes eram fixos — consultores, licenças de software especializado, desenvolvimentos personalizados — em implantações variáveis que escalam conforme o uso. Para uma pequena ou média empresa com recursos limitados de TI, isso representa uma mudança de lógica financeira significativa. Deixa de pagar por capacidade instalada e paga por resultado operacional.

Mas a modularidade tem um lado obscuro: cada módulo herda os pressupostos de quem o projetou. Um agente de RH que gera ofertas de emprego, materiais de integração e cartas de oferta não é neutro. Reflete uma ideia implícita de que candidato é desejável, que linguagem é profissional, que estrutura de carreira é a norma. Esses pressupostos não estão visivelmente no código. Estão nos dados com os quais o modelo foi treinado e, antes disso, nas decisões de quem escolheu esses dados.

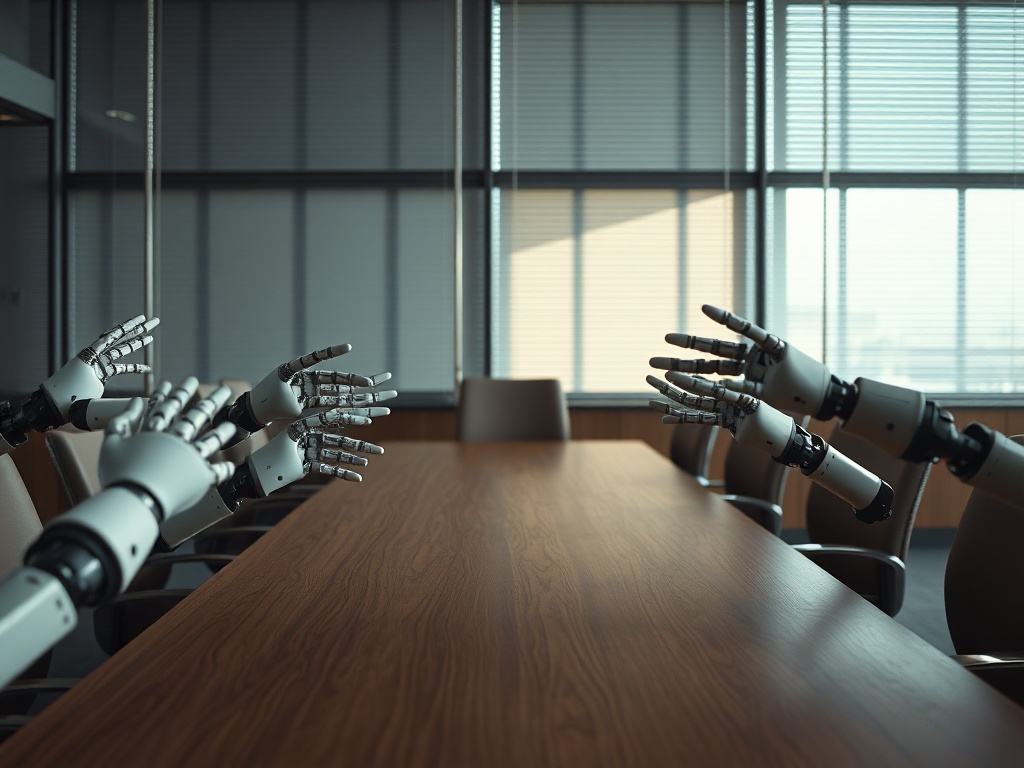

A pergunta que nenhum comunicado de lançamento responde é: quem estava naquela sala?

Quando o ponto cego se automatiza em escala

Há um dado no briefing da Anthropic que merece atenção direta: a análise de milhões de interações humano-agente mostra que quase 50% da atividade agente se concentra em engenharia de software. Finanças, saúde e cibersegurança aparecem como setores emergentes. Isso significa que os padrões de uso que informaram o design do sistema — os comportamentos que o modelo aprendeu como "normais" e eficientes — provêm de um perfil de usuário muito específico.

As equipes de engenharia de software são, em termos de composição demográfica, um dos segmentos laborais mais homogêneos da economia global. Quando esse perfil gera 50% do sinal de treinamento para um sistema que depois será implantado em recursos humanos, finanças e jurídico — funções que gerenciam contratação, compensação, crédito, conformidade — a homogeneidade da origem contamina a amplitude do destino.

Isso não é uma acusação à Anthropic. É um diagnóstico estrutural que se aplica a toda a indústria e que os líderes corporativos que adotam essas ferramentas devem considerar em sua avaliação de risco. Um agente de IA que automatiza a triagem de currículos em um departamento de RH pode reduzir o tempo do processo em uma porcentagem substancial. Também pode replicar, em uma velocidade industrial, os preconceitos que antes levavam semanas para operar. O ganho de eficiência e o risco de preconceito não são forças que se cancelam: se multiplicam juntas.

As PMEs, que não têm equipes de auditoria de algoritmos ou departamentos de ética tecnológica, são particularmente vulneráveis a esse padrão. Adotam a ferramenta pelos benefícios de velocidade — legítimos — e assumem que, se vem de um fornecedor reconhecido, o problema do preconceito já foi resolvido. Não foi resolvido. Foi terceirizado.

A rede que suporta a ferramenta é tão importante quanto a ferramenta

Há outro ângulo neste lançamento que as análises técnicas tendem a ignorar. A Anthropic anunciou simultaneamente a expansão de sua divisão experimental com o cofundador do Instagram à frente e a incorporação de uma nova responsável de produto proveniente do setor. Trata-se de uma rede de vínculos estratégicos construída sobre reputações cruzadas, históricos compartilhados e confiança acumulada em círculos muito específicos do ecossistema tecnológico do Vale do Silício.

Essa rede tem valor. Também tem limites geográficos, culturais e setoriais muito concretos. Uma rede de capital social construída dentro de um mesmo perímetro não detecta os sinais que vêm de fora desse perímetro. Para as empresas que operam em mercados da América Latina, do sul da Europa ou do sudeste asiático, isso implica que as prioridades de design do produto raramente refletirão suas fricções operativas específicas: marcos legais distintos, estruturas laborais diferentes, culturas de gestão que não se encaixam com os pressupostos anglo-saxões que estão por trás dos módulos pré-construídos.

A promessa de personalização via mercados internos privados é real, mas tem um piso de partida. E esse piso foi construído a partir de um lugar específico, por pessoas específicas, com experiências específicas. As empresas que entenderem isso poderão extrair valor do sistema; as que não entenderem adotarão acrítica um conjunto de pressupostos que não lhes pertencem.

A decisão de integrar agentes de IA em processos de RH, finanças ou jurídico não é apenas uma decisão tecnológica. É uma decisão de governança. Envolve escolher quais critérios automatizar, quais fluxos acelerar e, por omissão, quais perspectivas ficam de fora do processo de decisão. Essas escolhas têm consequências operacionais mensuráveis: na qualidade de contratação, na exposição legal, na capacidade de atender mercados diversos. As organizações que tratam a adoção de agentes de IA como uma decisão de TI em vez de uma decisão de diretoria estão subestimando o risco.

A diretoria que não viu seu próprio ponto cego

O lançamento da Anthropic não é o problema. É o espelho. Mostra claramente que a próxima camada de infraestrutura corporativa — os agentes que gerenciarão contratações, avaliarão crédito, redigirão contratos — está sendo projetada por equipes com perfis muito similares entre si, para clientes que também tendem a parecer-se entre si, com dados que refletem comportamentos de usuários que em 50% provêm de um único setor.

Os líderes que adotarem essas ferramentas sem auditar os pressupostos que vêm integrados nelas não estarão economizando tempo. Estarão delegando suas decisões mais sensíveis a um sistema que não foi calibrado para sua realidade específica. E quando esse sistema falhar — pois falhará, em algum processo, ante algum perfil de candidato ou cliente que não se encaixou no molde — a responsabilidade não será do fornecedor. Será de quem assinou a adoção sem fazer as perguntas que deveriam ser feitas.

Da próxima vez que a diretoria se reunir para aprovar a integração de agentes de IA, vale a pena que cada pessoa naquela sala olhe ao seu redor. Se todos chegaram pelos mesmos caminhos, trabalharam nos mesmos setores e compartilham os mesmos marcos de referência, já têm a resposta sobre quais pontos cegos essa diretoria tem garantidos. E esses pontos cegos são exatamente o que o sistema que estão prestes a adotar vai amplificar.