Agenti di IA per le PMI: chi stabilisce le regole del gioco

Il 24 febbraio 2026, Anthropic ha annunciato il suo programma di agenti per PMI: un insieme di moduli preconfezionati per implementare il modello Claude in attività di finanza, risorse umane, legale e ingegneria, collegati con strumenti come Gmail, DocuSign e piattaforme di dati. L'annuncio è stato preciso e tecnicamente solido. La promessa, come ha sottolineato la direttrice per l'America Kate Jensen, è che questa volta l'IA entrerà davvero nei flussi di lavoro aziendali.

Con 100 milioni di download mensili del suo protocollo di connessione standard e Claude Code che sta rapidamente scalando per diventare un prodotto di fatturato miliardario in sei mesi, Anthropic non sta speculando. Sta eseguendo. E quando un'azienda di questo calibro muove le sue pedine in modo così significativo, i leader aziendali hanno due opzioni: leggere il comunicato stampa o approfondire l'architettura sottostante.

Io scelgo la seconda opzione.

La promessa è modulare, anche il rischio

Il modello di Anthropic è intelligente dal punto di vista dell'ingegneria del prodotto. Invece di vendere una piattaforma monolitica che ciascuna azienda deve adattare da zero, offre moduli funzionali — un agente per la modellazione finanziaria, un altro per generare descrizioni di posti di lavoro, un altro per specifiche tecniche — che i team IT possono personalizzare all'interno di mercati interni controllati. Matt Piccolella, il responsabile del prodotto, l'ha sintetizzato così: ogni persona dovrebbe avere il proprio agente su misura, gestito centralmente.

Questa architettura modulare trasforma costi che prima erano fissi — consulenti, licenze software specializzate, sviluppi su misura — in distribuzioni variabili che si scalano in base all'uso. Per una PMI con risorse IT limitate, questo rappresenta un cambiamento significativo nella logica finanziaria. Non si paga più per la capacità installata, ma per il risultato operativo.

Tuttavia, la modularità ha un lato oscuro: ogni modulo eredita i presupposti da chi lo ha progettato. Un agente di HR che genera offerte di lavoro, materiali di integrazione e lettere di offerta non è neutro. Riflette un'idea implicita di quale candidato sia desiderabile, quale linguaggio sia professionale, quale struttura di carriera sia la norma. Questi presupposti non sono chiaramente visibili nel codice ma risiedono nei dati con cui il modello è stato addestrato e, prima ancora, nelle scelte di chi ha selezionato quei dati.

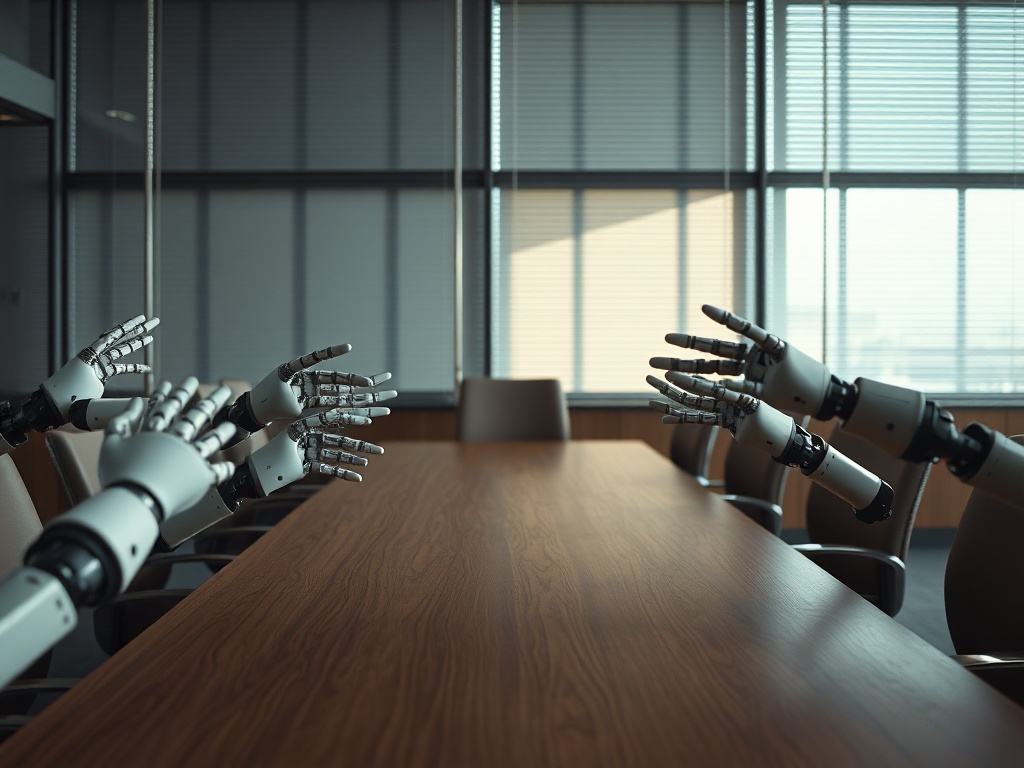

La domanda a cui nessun comunicato di lancio risponde è: chi c'era in quella stanza.

Quando il punto cieco viene automatizzato su scala

C'è un dato nel briefing di Anthropic che merita attenzione: l'analisi di milioni di interazioni umano-agente mostra che quasi il 50% dell'attività agentica si concentra nell'ingegneria del software. Finanza, sanità e cybersicurezza emergono come settori in crescita. Ciò significa che i modelli di utilizzo che hanno informato il design del sistema — i comportamenti che il modello ha imparato come "normali" ed efficienti — provengono da un profilo di utente molto specifico.

I team di ingegneria del software sono, in termini di composizione demografica, uno dei segmenti lavorativi più omogenei dell'economia globale. Quando quel profilo genera il 50% del segnale di addestramento per un sistema che poi verrà distribuito in HR, finanza e legale — funzioni che gestiscono assunzioni, compensi, crediti e conformità — l'eterogeneità dell'origine contaminerà la vastità della destinazione.

Questo non è un'accusa a Anthropic. È una diagnosi strutturale che si applica a tutta l'industria e che i leader aziendali che adotteranno questi strumenti devono considerare nella loro valutazione del rischio. Un agente di IA che automatizza il screening dei curriculum in un dipartimento di HR può ridurre il tempo del processo in modo sostanziale. Può anche replicare a velocità industriale i pregiudizi che prima impiegavano settimane a manifestarsi. L'aumento dell'efficienza e il rischio di pregiudizio non sono forze che si annullano: si moltiplicano insieme.

Le PMI, che non dispongono di team di audit di algoritmi né di uffici di etica tecnologica, sono particolarmente vulnerabili a questo modello. Adottano lo strumento per i legittimi benefici di velocità e assumono che se proviene da un fornitore noto, il problema del pregiudizio sia già stato risolto. Non è stato risolto. È stato esternalizzato.

La rete che sostiene lo strumento è importante quanto lo strumento stessa

C'è un'altra angolazione in questo lancio che le analisi tecniche tendono a ignorare. Anthropic ha annunciato contemporaneamente l'espansione della sua divisione sperimentale con il cofondatore di Instagram a capo e l'inserimento di una nuova responsabile del prodotto proveniente dal settore. Si tratta di una rete di legami strategici costruita su reputazioni incrociate, storie condivise e fiducia accumulata in cerchie molto specifiche dell'ecosistema tecnologico di Silicon Valley.

Questa rete ha valore. Ha anche limiti geografici, culturali e settoriali molto concreti. Una rete di capitale sociale costruita all'interno di un determinato perimetro non rileva i segnali che provengono dall'esterno di quel perimetro. Per le aziende che operano nei mercati dell'America Latina, nel sud dell'Europa o nel sud-est asiatico, questo implica che le priorità di design del prodotto raramente rifletteranno le loro frizioni operative specifiche: quadri normativi diversi, strutture lavorative diverse, culture di gestione che non si adattano ai presupposti anglosassoni che sottendono ai moduli preconfezionati.

La promessa di personalizzazione tramite mercati interni privati è reale, ma ha un pavimento di partenza. E quel pavimento è stato costruito da un luogo specifico, da persone specifiche, con esperienze specifiche. Le aziende che comprenderanno questo potranno estrarre valore dal sistema; quelle che non lo comprenderanno adotteranno in modo critico un insieme di presupposti che non appartengono loro.

La decisione di integrare agenti di IA nei processi di HR, finanza o legale non è solo una decisione tecnologica. È una decisione di governance. Implica scegliere quali criteri automatizzare, quali flussi accelerare e, per omissione, quali prospettive restano escluse dal processo decisionale. Queste scelte hanno conseguenze operative misurabili: nella qualità delle assunzioni, nell'esposizione legale, nella capacità di servire mercati diversificati. Le organizzazioni che trattano l'adozione di agenti di IA come una decisione IT invece che come una decisione di consiglio di amministrazione stanno valutando male il rischio.

Il consiglio di amministrazione che non ha visto arrivare il proprio punto cieco

Il lancio di Anthropic non è il problema. È lo specchio. Mostra chiaramente che il prossimo strato di infrastruttura aziendale — gli agenti che gestiranno le assunzioni, valuteranno i crediti, redigeranno contratti — sta venendo progettato da team con profili molto simili tra loro, per clienti che tendono anche a assomigliarsi, con dati che riflettono comportamenti di utenti che per il 50% provengono da un solo settore.

I leader che adotteranno questi strumenti senza esaminare i presupposti integrati in essi non risparmieranno tempo. Stanno delegando le loro decisioni più sensibili a un sistema che non è stato calibrato per la loro realtà specifica. E quando quel sistema fallirà — perché fallirà, in qualche processo, di fronte a qualche profilo di candidato o cliente che non si adattava al modello — la responsabilità non sarà del fornitore. Sarà di chi ha firmato l'adozione senza fare le domande necessarie.

La prossima volta che il consiglio di amministrazione si riunirà per approvare l'integrazione di agenti di IA, vale la pena che ciascuna persona in quella stanza guardi intorno a sé. Se tutti sono arrivati per le stesse strade, hanno lavorato negli stessi settori e condividono gli stessi quadri di riferimento, già hanno la risposta su quali punti ciechi quel consiglio di amministrazione ha garantito. E quegli punti ciechi sono esattamente ciò che il sistema che stanno per adottare andrà ad amplificare.