Die aufgeblähte Kennzahl, die Milliarden kosten kann: Die Illusion der Leistung in 2D-Transistoren

Seit fast 20 Jahren gelten 2D-Halbleiter als verheißungsvolles Material: Materialien wie Molybdändisulfid (MoS₂) könnten ultradünne Kanäle, effiziente Schaltungen und einen weiterführenden Weg zur Miniaturisierung von Transistoren bieten, wenn das Silizium an seine praktischen Grenzen stößt. Die Erzählung stützte sich auf Laborergebnisse, die auf den ersten Blick zeigten, dass der Sprung bevorstand.

Das Problem ist, dass ein großer Teil dieser vergleichenden Beweise auf einer Testarchitektur basieren könnte, die keine zukünftige Integration in kommerzielle Chips repräsentiert. Eine Studie der Duke University, veröffentlicht am 17. Februar 2026 in ACS Nano, bringt eine unangenehme Wahrheit ans Licht: Die weit verbreitete „Back-Gated“-Konfiguration, die aufgrund ihrer experimentellen Einfachheit beliebt ist, kann die gemessene Leistung um bis zu sechs Mal aufblähen durch einen Effekt namens „Contact Gating“, der den Kontaktwiderstand verringert, aber physikalische Grenzen auferlegt, die mit der industriellen Realität kollidieren, einschließlich Stromleckagen und Geschwindigkeitsbeschränkungen.

Als Analyst für Diversität, Gleichheit und Sozialkapital ist meine Sichtweise nicht moralisch, sondern strategisch. Wenn ein ganzes Feld sich daran gewöhnt, „Fortschritt“ mit Instrumenten zu messen, die eine Illusion belohnen, wird das Risiko nicht verteilt: Es konzentriert sich. Die Kosten trägt das I+D-Portfolio, die technologische Roadmap und der Ruf der Führung, die auf leicht zu feiernde Kennzahlen gesetzt hat.

Der Duke-Befund: Wenn das Experimentdesign die berichtete Physik verändert

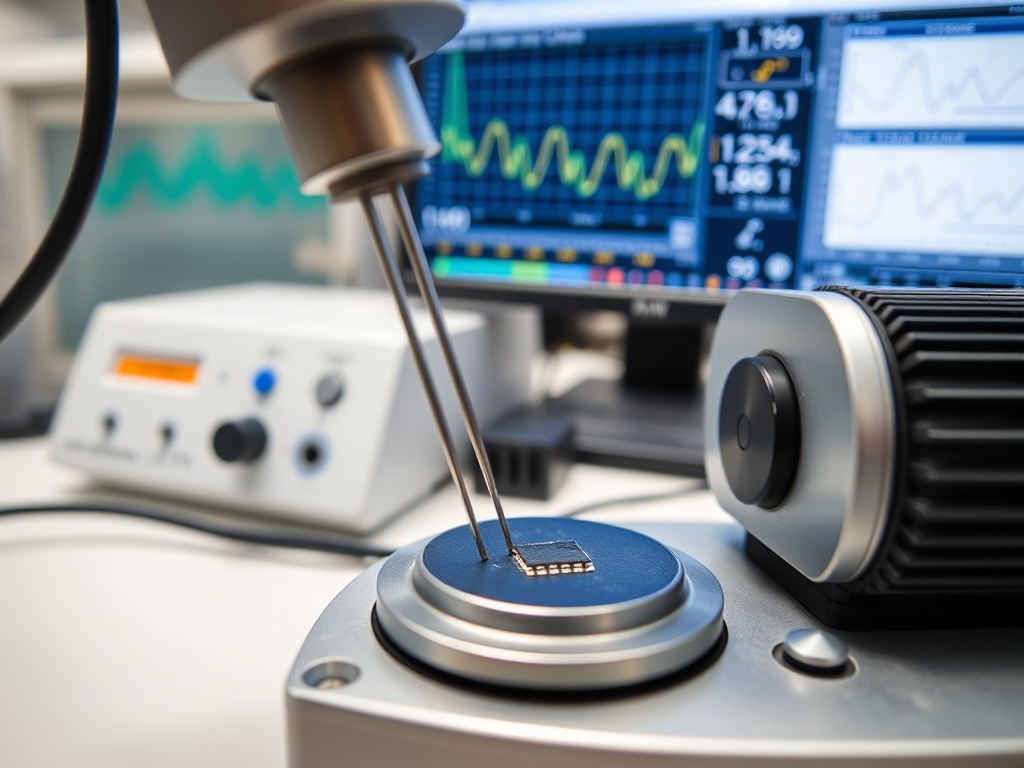

Das von Aaron Franklin geleitete Team, unterstützt durch die entscheidenden experimentellen Arbeiten von der Doktorandin Victoria Ravel, verglich kontrolliert, wie sich 2D-Transistoren verhalten, wenn das Gate, das den Kanal moduliert, vom Gate, das die Kontaktregionen beeinflusst, getrennt wird. Die „Back-Gated“-Architektur platziert den Kanal auf einem Siliziumsubstrat, das als Gate fungiert; dieses Gate modifiziert nicht nur den Kanal, sondern verändert auch die metallischen Kontakte, die den Strom einspeisen. Dieser “Doppelteffekt” ist das Herz des Contact Gating.

In geschäftlichen Begriffen ist der Unterschied enorm: Das Experiment misst nicht nur das Material, sondern auch eine architektonische Abkürzung. Die Forschung stellte ein symmetrisches Dual-Gate-Design her, das es ermöglicht, entweder das obere oder das hintere Gate unabhängig über demselben MoS₂-Kanal zu aktivieren und den Effekt der Kontakte zu isolieren. Unter größeren Geräten verdoppelte sich die Leistung unter bestimmten Bedingungen, was bereits zeigt, dass die Architektur selbst vor dem Skalieren wichtig ist.

Doch die entscheidende Botschaft, die Entscheidungen verändert, tritt zutage, wenn man auf Dimensionen skaliert, die für zukünftige Chips relevant sind: Mit 50 nm Kanalänge und 30 nm Kontaktlängen erhöhte das Contact Gating den Strom im „on“-Zustand um fast 70% und hob die gemeldete Leistung bis zu sechsmal an. Franklin sagte es unverblümt: „Die meisten Berichte über Hochleistungs-2D-Transistoren verwenden ein Gerätedesign, das nicht mit kommerziellen Technologien kompatibel ist... und die Leistung erheblich aufblähen kann“.

Das ist kein akademisches Detail. Es ist eine Erinnerung daran, dass die Industrie Äpfel mit Laborobjekten vergleichen könnte. Und wenn Budgets, Beschaffungen, Allianzen und Talente auf verzerrten Benchmarks basieren, werden Schlösser auf Sand gebaut.

Die Wirtschaft des technischen Hypes: Wenn ein verzerrter Benchmark Kapital und Prioritäten neu ordnet

Der Hype entsteht nicht nur durch Marketing. In der Deep-Tech-Branche wird er durch strukturelle Anreize erzeugt: veröffentlichen, „State of the Art“ zeigen, Finanzierung erhalten und eine Erzählung über Kontinuität aufrechterhalten. Wenn das schnellste Mittel, um „gute“ Ergebnisse zu erzielen, eine einfache Testarchitektur ist — und diese Einfachheit zum Standard wird — beginnt die gesamte Disziplin, für den Test zu optimieren, nicht für das Produkt.

Duke macht diese Verzerrung messbar: bis zu 6x Inflation ist kein Fehler; es ist ein Multiplikator, der Investitionsentscheidungen beeinflusst. Ohne spezifische Finanzdaten in den Quellen bleibt die Implikation klar: Der Sektor investiert Milliarden in die I+D von Halbleitern und in Skalierungswege, bei denen bereits ein Prozentpunkt in Leistung oder Energie komplette Investitionszyklen bewegt. Wenn ein Teil der Gemeinschaft Verbesserungen feiert, die von einem Design abhängen, das wegen Problemen wie Leckagen und Geschwindigkeitsbeschränkungen nicht integrierbar ist, nimmt das Unternehmensrisiko dreifache Formen an.

Erstens, Kapitalzuweisungsrisiko: Es werden Materialien oder Ansätze finanziert, die auf der „Back Gate“-Plattform überlegen aussehen, aber die Vorteile bei der Umstellung auf kompatible Architekturen verlieren. Zweitens, Zeitplanrisiko: Roadmaps, die eine nahe technische Reife annehmen, können sich verzögern, wenn die Benchmarks korrigiert werden. Drittens, Ruf- und Governance-Risiko: Wenn ein Technologieausschuss nicht erklären kann, warum ein Leistungssprung beim Wechsel des Setups verschwindet, erodiert das Vertrauen des Vorstands in die I+D-Funktion.

Franklin weist auch auf eine typische Spannung hin: „Die Verstärkung der Leistung klingt nach einer guten Sache… aber… hat physikalische Grenzen, die ihre Verwendung in einer tatsächlichen Gerätetechnologie verhindern“. Übersetzt in C-Level-Sprache: Das Labor könnte einen KPI maximieren, den der Markt nicht honoriert. Das ist die teuerste Art des Fortschritts.

Der blinde Fleck in der Organisation: Technische Homogenität und geschlossene Netzwerke, die Fehler normalisieren

Hier kommt mein Blickwinkel ins Spiel: Die Verzerrung ist nicht nur architektonisch, sondern auch sozialarchitektonisch. Über zwei Jahrzehnte hat sich eine Benchmarking-Praxis normalisiert. Das passiert selten, weil „niemand etwas wusste“. Es geschieht, weil die Netzwerke, die Wissen validieren — Gutachter, Referenzlabore, Meinungsführer — oft geschlossen und selbstreferenziell sind. Wenn das Netzwerk zu vertikal wird, konzentriert sich die Macht zu definieren, was „gute Leistung“ ist.

Die Studie beschreibt ein Phänomen, das „die meisten Laborversuche betrifft“ und das eine Neubewertung von Hunderten von vorherigen Studien erfordert. Diese Art von Feldkorrektur verlangt nach mehr als nur einem Paper: Es erfordert technische Dissensfähigkeit innerhalb der Gemeinschaften, die Standards setzen. In Unternehmensorganisationen bedeutet das Teams, die keine Klone in Bezug auf Bildung, Anreize und Netzwerke sind.

Ein homogener Vorstand scheitert oft an einer spezifischen Mechanik: Er verwechselt Konsens mit Wahrheit. Wenn der technische Tisch denselben akademischen Hintergrund, dieselben Kongresse, denselben Validierungskreis und dieselben „Gurus“ teilt, wird das System anfällig für methodologische Vorurteile. Schlechtes Verhalten ist nicht notwendig. Ein Reputationskreis, der vergleichbare Ergebnisse belohnt und davon abweicht, wird sanktioniert.

Die operative Lektion ist unangenehm: Nützliche Diversität in Deep Tech ist nicht kosmetisch. Es ist Diversität in Disziplinen (Fertigung, Design, Integration, Zuverlässigkeit, Herstellung), Diversität in Anreizen (Forschung vs. Produkt) und Diversität in Netzwerken (Personen, die nicht vom gleichen sozialen Kapital abhängen, um voranzukommen). In der Ausführung funktionierte das Contact Gating über Jahre als „Abkürzung“, weil es einfach zu verwenden war und attraktive Zahlen lieferte. Geschlossene Netzwerke machen diese Abkürzungen zu Dogmen.

Wenn Franklin sagt: „Wir müssen ehrlich sein, wie die Gerätearchitektur das, was wir messen, beeinflusst“, beschreibt er indirekt eine Wissensgovernance-Panne: Wenn der Maßstab, der verwendet wird, eine Illusion belohnt, läuft das gesamte Ökosystem in die falsche Richtung.

Was ein C-Level ab morgen verlangen sollte: Integrierbare Benchmarks und ein technisches Netzwerk, das "Nein" sagen kann

Der Wert der Studie besteht nicht darin, 2D abzulehnen. Es geht darum, einen Disziplinwechsel zu erzwingen: Materialentdeckung von Testarchitektur und Kompatibilität mit kommerzieller Integration zu trennen. Duke schlägt eine Grundlage vor: Designs wie das Dual-Gate, um gerechter und reproduzierbarer zu bewerten. Außerdem plant das Team, Kontaktlängen auf 15 nm zu skalieren und alternative Metalle zu testen, um den Kontaktwiderstand innerhalb kompatibler Einschränkungen zu reduzieren.

Für das C-Level wird dies zu einer Checkliste, nicht zu einer akademischen Diskussion:

- Neudefinition der I+D-KPIs: Verlangen, dass jeder „Rekord“ der Leistung in 2D mit dem Setup und einer expliziten Erklärung versehen ist, ob die Architektur integrierbar oder lediglich demonstrativ ist. Die Zahl ohne Kontext ist kein Beweis mehr.

- Governance der Validierung: Einführung von Kreuzprüfungen mit Profilen, die nicht im selben Publikationskreis gefangen sind. Dazu gehören Herstellungsingenieure, Zuverlässigkeitsexperten und Personen, die Technologietransitionen erlebt haben, bei denen die Benchmarks bei der Industrialisierung zerbrochen sind.

- Architektur des sozialen Kapitals: Aufbau von horizontalen Beziehungen zu Laboren und Teams, die die dominante Erzählung ohne den rufschädigenden Preis eines „Abweichens vom Standard“ in Frage stellen können. In der harten Innovation ist das wertvollste Netzwerk nicht das, das zuerst applaudiert; es ist das, das den Fehler vorher erkennt.

Die Halbleiterindustrie kann sich nicht erlauben, noch zwei Jahrzehnte lang für das Schaufenster des Labors zu optimieren. Die Botschaft von Duke ist ein Aufruf zur Reifung: Messen wie man produziert und produzieren wie man verkauft.

Das Mandat für die Unternehmensleitung ist klar: In der nächsten Vorstandssitzung muss sich das C-Level an den eigenen Tisch wenden und erkennen, dass, wenn alle zu ähnlich sind, sie die gleichen blinden Flecken teilen und als baldige Opfer der Disruption positioniert sind.